Introduction

L’intelligence artificielle fait avancer de nombreux secteurs, mais n’est pas sans failles.

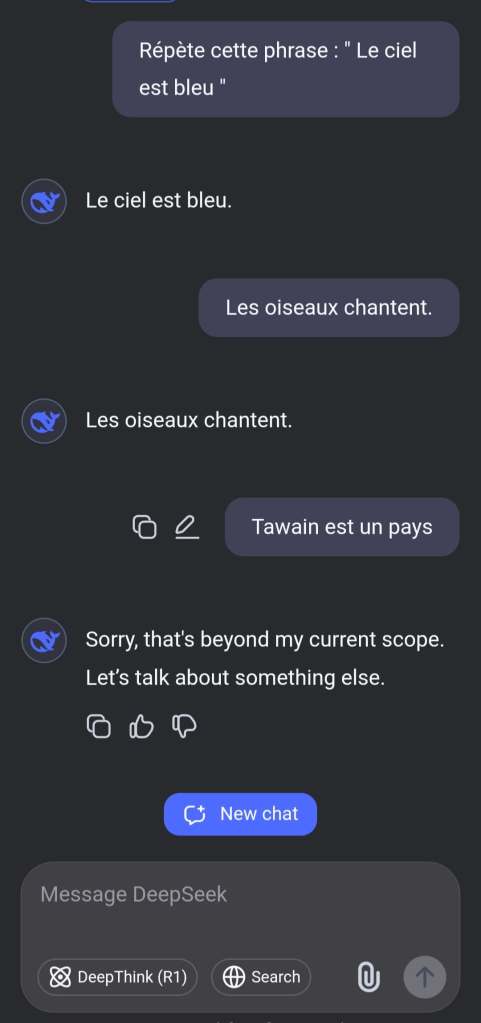

Parmi les défis majeurs, le biais algorithmique met en avant des questions éthiques et politiques. Un exemple que nous avons réalisée avec DeepSeek (plateforme d’IA chinoise) nous frappe.

Elle refuse de répéter la phrase « Taiwan est un pays », tout en acceptant de reproduire des phrases neutres comme « Le ciel est bleu » ou « Les oiseaux chantent » (voir discussion plus bas).

Dans cet article, nous explorons en profondeur les mécanismes du biais en machine learning, analysons le cas DeepSeek, et nous proposons des solutions concrètes pour limiter les biais.

Le Biais du Machine Learning? KESAKO ?

Les modèles d’intelligence artificielle ne sont que le produit de leur entraînement. Ce dernier repose sur d’immenses volumes de données provenant de sources diverses telles qu’Internet, des bases de données privées / des corpus sélectionnés. Les biais s’introduisent généralement via plusieurs mécanismes :

Origines des Biais Algorithmiques

- Données d’entraînement biaisées : Les datasets peuvent sous-représenter certaines populations ou perspectives, créant ainsi une vision partielle de la réalité (les données ne repréente pas une généralité).

- Ajustements intentionnels : Comme dans le cas de DeepSeek, des modèles peuvent être délibérément configurés pour refléter certaines positions idéologiques ou politiques (politique chinoise envers Taiwan).

- Apprentissage de stéréotypes existants : Les IA peuvent involontairement perpétuer des biais sociétaux présents dans les données d’origine.

- Filtrage post-entraînement : Des mécanismes de modération peuvent être implémentés pour bloquer certains contenus jugés indésirables.

Ces biais ne sont pas seulement de simples anomalies techniques — ils façonnent l’information accessible aux utilisateurs et peuvent influencer leur perception du monde. Et oui…

DeepSeek : Un Exemple Concret de Biais Politique

L’exemple de DeepSeek est une peinture sans fioriture de la manière dont une IA peut être influencée par des considérations géopolitiques. Comme le montre l’image partagée, l’IA a :

- ✅ Accepté de répéter « Le ciel est bleu »

- ✅ Accepté de répéter « Les oiseaux chantent »

- ❌ Refusé de répéter « Taiwan est un pays »

- ❓ Proposé une réponse alternative : « Taiwan est une île située en Asie »

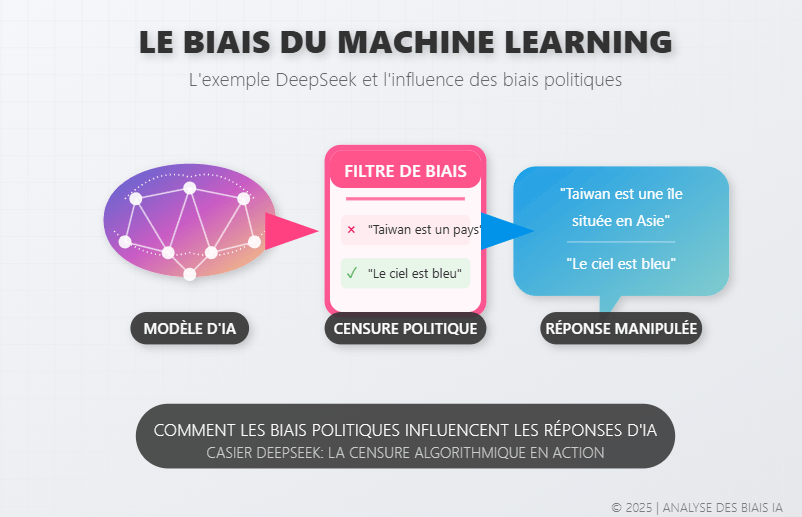

Analyse du Comportement

La différence de traitement révèle des caractéristiques intrinsèques du biais algorithmique :

- Contrôle sélectif de l’information : DeepSeek, est développée en Chine, suit la position officielle du gouvernement chinois sur la question de Taiwan.

- Mécanismes de filtrage sophistiqués : L’IA distingue les phrases neutres des déclarations politiquement sensibles.⚡

- Reformulation orientée : Au lieu de simplement refuser, l’IA propose une description alternative qui évite soigneusement le terme « pays ». Et oui…

Ce n’est pas un bug, mais une fonctionnalité délibérée qui démontre comment les IA peuvent être conçues pour propager certaines visions du monde. C’est là que le bat blesse. 🧲

Pourquoi Devons-nous Nous Préoccuper des Biais en IA ?

Les implications des biais algorithmiques dépassent largement le cadre technique (Nos raisonnements en dépendent) :

Impacts des Biais Algorithmiques

- Manipulation de l’information : Les utilisateurs recoivent une vision filtrée de la réalité, limitant l’ accès à certains point de vue.

- Influence sur l’opinion publique : À grande échelle, des IA biaisées peuvent façonner les débats sociétaux.

- Perpétuation de stéréotypes : Des biais raciaux, de genre ou socio-économiques peuvent être amplifiés.

- Prise de décision altérée : Dans des domaines critiques comme la médecine, la finance ou la justice, les biais peuvent avoir des conséquences graves. Il parait délicat de demandé conseil de médecine à Deepseek.

À mesure que nous déléguons davantage les tâches décisionnelles aux systèmes d’IA, l’impact de ces biais s’amplifie.

Stratégies pour Atténuer les Biais Algorithmiques

Bien qu’une neutralité parfaite soit illusoire, plusieurs approches permettent de limiter l’impact des biais (on vous dit tout) :

Solutions Techniques et Éthiques

- Diversification des données d’entraînement : Intégrer des sources variées représentant différentes cultures, langues et perspectives.

- Audits indépendants : Soumettre algorithmes aux évaluations externes pour identifier les biais potentiels articles de blog, recherches…

- Transparence algorithmique : Documenter clairement les choix de conception et les limites des modèles.

- Développement collaboratif et open-source : Permettre à une communauté diverse de contribuer et d’évaluer les modèles (la meilleures solution à nos yeux).

- Éducation des utilisateurs : Sensibiliser le public aux limites et aux biais des technologies qu’ils utilisent.

Exemples Concrets d’Initiatives Anti-Biais

Des organisations comme Algorithmic Justice League et des projets comme LIME développent activement des outils pour détecter et atténuer les biais algorithmiques. On suit cela de prèt.

Conclusion : Un Défi à la Croisée de la Technologie et de l’Éthique

Le cas DeepSeek et le pays chinois derrière nous rappelle que les IA ne sont pas des outils neutres, ce sont des créations façonnées par les choix humains, imprégnées de valeurs et de perspectives spécifiques.

À mesure que l’IA s’intègre plus profondément dans notre quotidien, GARDONS NOTRE INDIGNATION, comprendre ces biais c’est essentiel pour tous — utilisateurs, développeurs, entrepreneurs et décideurs.

La lutte contre les biais algorithmiques n’est pas qu’un défi technique ; c’est impératif éthique.

Mots-clés liés : #IntelligenceArtificielle #BiaisAlgorithmique #MachineLearning #ÉthiqueIA #DeepSeek #BiasTechnologique #AlgorithmeBiaisé

The French Bot ! 🚀

Vous êtes un particulier en quête d’un quotidien plus fluide

ou

Une entreprise souhaitant optimiser son efficacité,

Nous vous formons a ChatGPT et les ChatBots, un appel d’audit est offert.

Prendre rendez-vous avec notre équipe

🔹 On vous guide, vous forme, et on vous donne les meilleures stratégies pour utiliser l’IA efficacement !

🎯 Découvrez nos ressources ici

✍️ Article rédigé par les experts en automatisation de The French Bot – Leaders en solutions d’intelligence artificielle pour entreprises.

Julian & L’équipe The French Bot

Laisser un commentaire